Exercice 3:

Montrer que $T_A$ et $T_B$ ont la même loi et que si $\sigma^2 = id$ alors les couples $(T_A, T_B)$ et $(T_B, T_A)$ ont la même loi.

Solution:

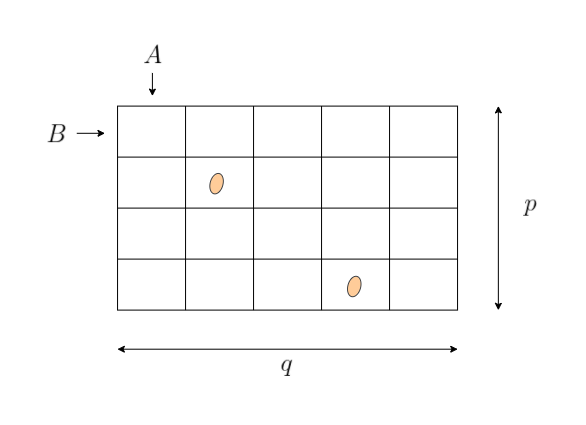

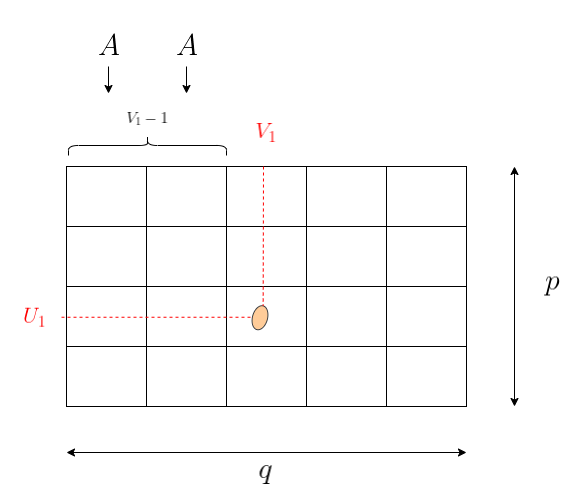

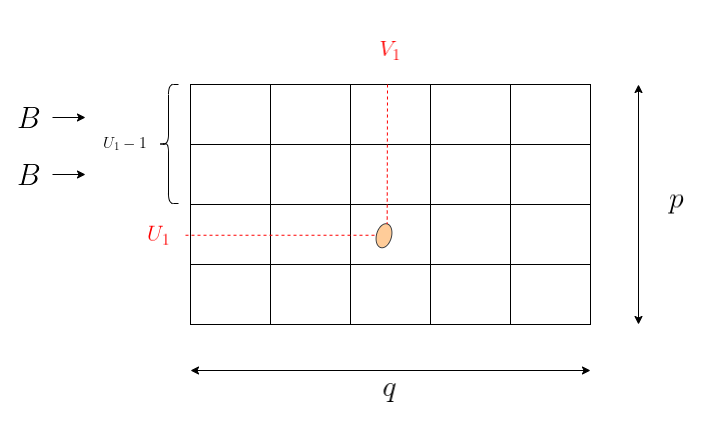

Pour montrer que $T_A$ et $T_B$ suivent la même loi, on commence par remarquer

qu'il existe une permutation $\sigma$ de $\{1,\ldots,p\times q\}$ telle que

$t^1_B=\sigma(t^1_A)$ et $t^2_B=\sigma(t^2_A)$ (elle est calculée

plus tard, mais c'est facile de s'en convaincre).

Comme $t^1_A$ et $t^2_A$ suivent des lois uniformes sur $\{1,\ldots,p \times q\}$, c'est aussi le cas de $t^1_B$ et $t^2_B$ (exercice).

$t^1_B$ et $t^2_B$ sont indépendantes, puisque fonctions de variables aléatoires

indépendantes.

Les couples $(t^1_A,t^2_A)$ et $(t^1_B,t^2_B)$ suivent donc la même loi et l'on conclut que $T_A$ et $T_B$ ont même loi puisque:

$$

T_A=\min(t^1_A,t^2_A),\quad T_B=\min(t^1_B,t^2_B).

$$

Il convient de noter que les temps aléatoires $T_A$ et $T_B$ ne sont pas indépendants. C'est d'ailleurs ce qui fait l'intérêt de

la question posée (Que se passerait-il si $T_A$ et $T_B$ étaient

indépendants?).

On peut montrer que si $\sigma^2=Id$, alors la loi du couple $(T_A,T_B)$ est identique à celle du couple $(T_B,T_A)$. En effet on a:

$$

T_A=\min(t^1_A,t^2_A),\quad T_B=\min(\sigma(t^1_A),\sigma(t^2_A))

$$

Donc, en utilisant le fait que la loi de $(t^1_A,t^2_A)$ est identique à celle de $(\sigma(t^1_A),\sigma(t^2_A))$, on obtient:

$$

\begin{align*}

\mathbb{P}\left(T_A=k,T_B=l\right) & = \mathbb{P}\left(\min(t^1_A,t^2_A)=k,\min(\sigma(t^1_A),\sigma(t^2_A))=l\right)\\

& = \mathbb{P} \left(\min(\sigma(t^1_A),\sigma(t^2_A))=k, \min(\sigma^2(t^1_A),\sigma^2(t^2_A))=l\right).

\end{align*}

$$

Et lorsque $\sigma^2=Id$, on en déduit $\mathbb{P} \left(T_A=k,T_B=l\right) = \mathbb{P}(T_B=k,T_A=l)$.

Ceci permet d'en déduire (exercice simple mais instructif) que

$$

\mathbb{P}(T_A<T_B)=\mathbb{P}(T_B<T_A).

$$

La relation $\sigma^2=Id$ est vérifiée lorsque $p=q$ (on peut le vérifier à l'aide du code ou le prouver si on est courageux). Ce qui prouve le résultat (attendu !) que lorsque $p=q$ le jeux est équilibré.